神经网络是人工智能 (AI) 的核心,为从发现照片中的物体到翻译语言的各种应用提供动力。在本文中,我们将深入探讨神经网络是什么,它们是如何工作的,以及为什么它们在当今技术驱动的世界中很重要。

Index 指数

·1:了解基础知识

∘ 1.1: 什么是神经网络?

∘ 1.2: 神经网络的类型

·2:神经网络的架构

∘ 2.1: 神经元的结构

∘ 2.2: 图层

∘ 2.3: 层在学习中的作用

·3:神经网络的数学

∘ 3.1: 加权总和

∘ 3.2: 激活函数

∘ 3.3: 反向传播:神经学习的核心

∘ 3.4: 分步示例

∘ 3.5: 改进

·4:实现神经网络

∘ 4.1: 用 Python 构建简单的神经网络

∘ 4.2: 利用库实现神经网络 (TensorFlow)

·5:挑战

∘ 5.1: 克服过拟合

·6:结论

1:了解基础知识

1.1: 什么是神经网络?

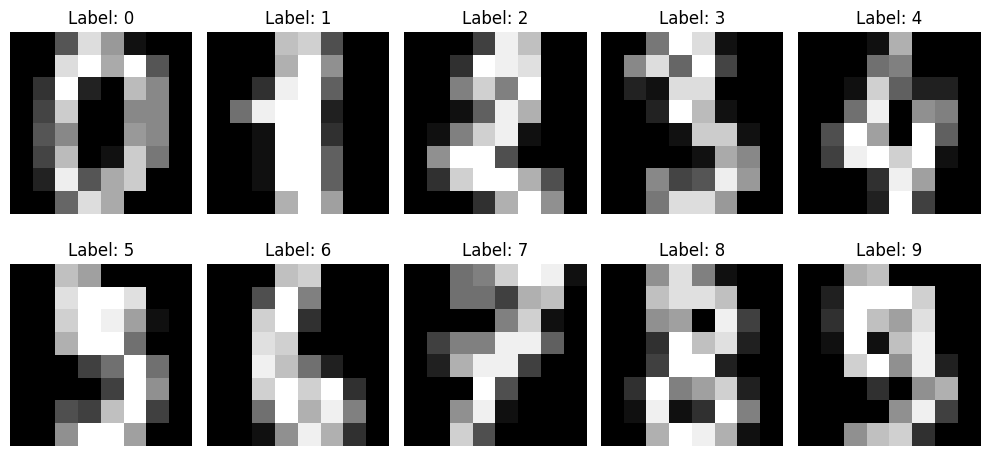

神经网络是生物学和计算机科学的酷炫融合,灵感来自我们大脑处理复杂计算任务的设置。从本质上讲,它们是旨在发现模式和理解感官数据的算法,这使它们可以做很多事情,例如识别人脸、理解口语、做出预测和理解自然语言。